マスクの紐の入力インタフェース化

Designing and Identifying Gestures to Transform MaskStrap into an Input Interface

2023

山本匠,正井克俊,ウィタナアヌーシャ,杉浦裕太

Takumi Yamamoto, Katsutoshi Masai, Anusha Withana, Yuta Sugiura

[Reference /引用はこちら]

Takumi Yamamoto, Katsutoshi Masai, Anusha Withana, and Yuta Sugiura. 2023. Masktrap: Designing and Identifying Gestures to Transform Mask Strap into an Input Interface. In 28th International Conference on Intelligent User Interfaces (IUI ’23), March 27–31, 2023, Sydney, NSW, Australia. [DOI]

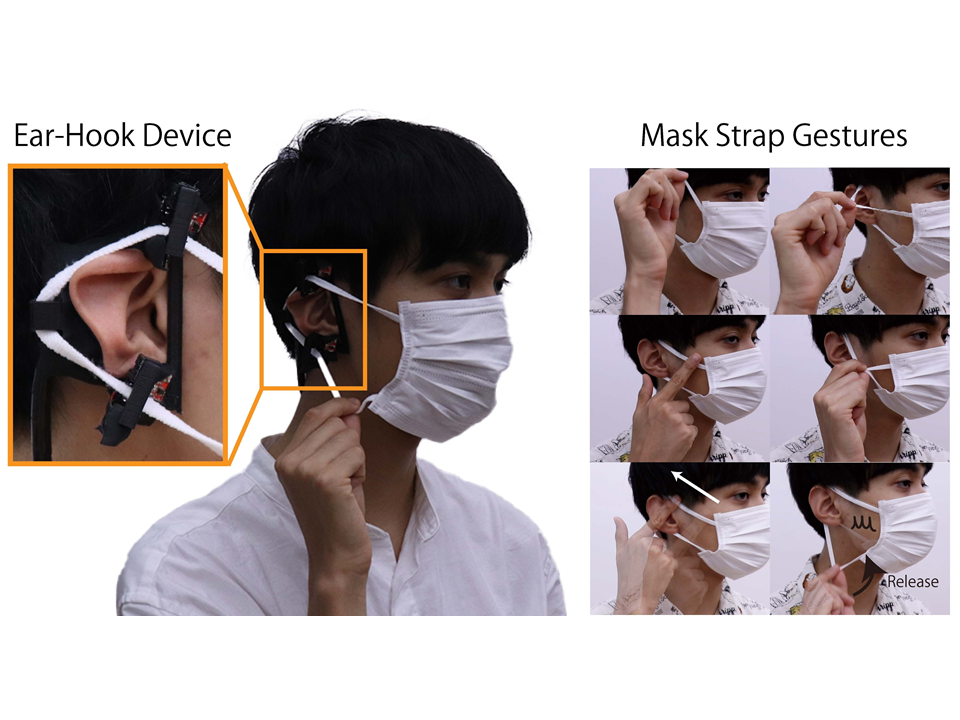

計算機の小型化に伴い、スマートウォッチやスマートグラス等のスマートデバイスが注目を集めている。本研究では、感染症の蔓延防止のために多くの人に着用されているフェイスマスクを用いたインタラクションを探求する。その中でも、本研究ではマスクの紐を入力インタフェースとして活用する手法を提案する。20人の被験者に対してジェスチャを考案させるElicitation Studyを通し、ユーザ定義のジェスチャセットをデザインした。さらに、実施にマスクの紐を用いたジェスチャを識別する耳掛け型デバイスを実装した。8人の被験者に対して精度を検証した結果、12個のジェスチャに対して93.07%の平均識別精度を得た。

Embedding technology into day-to-day wearables and creating smart devices such as smartwatches and smart-glasses has been a growing area of interest. In this paper, we explore the interaction around face masks, a common accessory worn by many to prevent the spread of infectious diseases. Particularly, we propose a method of using the straps of a face mask as an input medium. We identified a set of plausible gestures on mask straps through an elicitation study (N = 20), in which the participants proposed different gestures for a given referent. We then developed a prototype to identify the gestures performed on the mask straps and present the recognition accuracy from a user study with eight participants. Our results show the system achieves 93.07% classification accuracy for 12 gestures.