[引用はこちら/Reference]

Shunta Suzuki, Takashi Amesaka, Hiroki Watanabe, Buntarou Shizuki, and Yuta Sugiura. 2024. EarHover: Mid-Air Gesture Recognition for Hearables Using Sound Leakage Signals. In The 37th Annual ACM Symposium on User Interface Software and Technology (UIST ’24), October 13–16, 2024, Pittsburgh, PA, USA. ACM, New York, NY, USA, 13 pages. Best Paper Award [DOI]

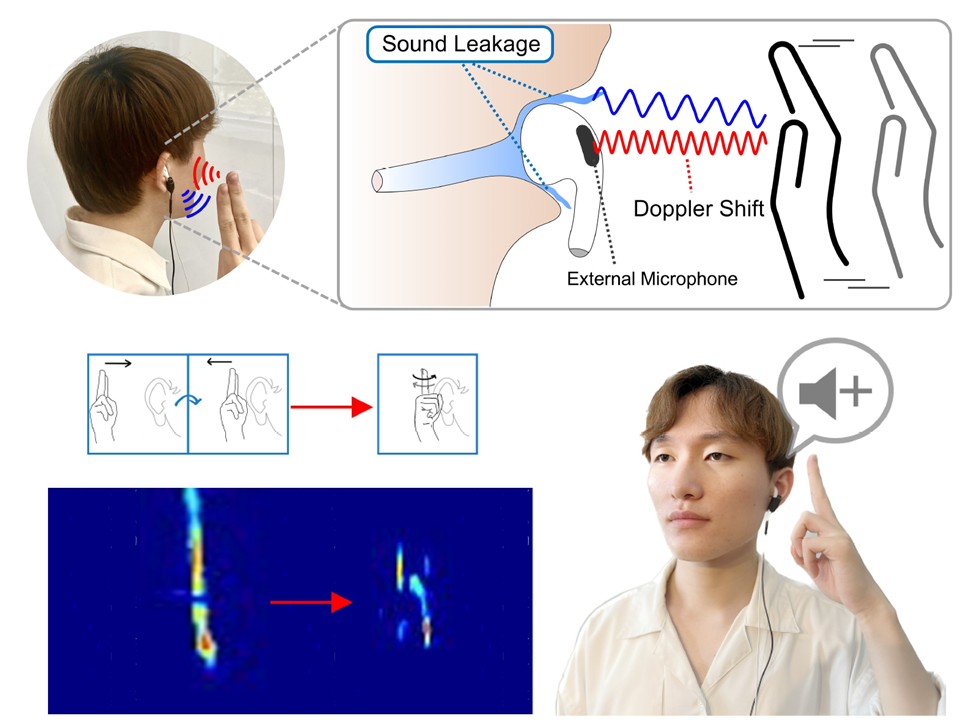

ヒアラブルデバイスにおける空中ジェスチャ入力を可能にするシステムEarHoverを提案する。空中ジェスチャ入力は、デバイスに直接触れる必要がないため、手やデバイスを清潔に保つことができる。既存の空中ジェスチャ入力方法は、カメラや赤外線センサーなどの追加が必要であったが、ヒアラブルデバイス特有の音漏れに着目することで、スピーカと外部マイクを使用した空中ジェスチャ認識を実現した。ヒアラブルデバイス外部に漏れる信号は外部マイクによって測定を行い、空中ジェスチャ中の手の速度や形状によって引き起こされる反射特性の違いを検出する。27種類のジェスチャの中から、信号の識別性とユーザの受け入れやすさの観点からEarHoverに適した7つのジェスチャを決定した。そして、実際のアプリケーションシナリオにおいて、2つのプロトタイプデバイス(インイヤー型/オープンイヤー型)のジェスチャ検出および分類性能を評価した。

We introduce EarHover, an innovative system that enables mid-air gesture input for hearables. Mid-air gesture input, which eliminates the need to touch the device and thus helps to keep hands and the device clean. However, existing mid-air gesture input methods for hearables have been limited to adding cameras or infrared sensors. By focusing on the sound leakage phenomenon unique to hearables, we have realized mid-air gesture recognition using a speaker and an external microphone that are highly compatible with hearables. The signal leaked to the outside of the device due to sound leakage can be measured by an external microphone, which detects the differences in reflection characteristics caused by the hand’s speed and shape during mid-air gestures. Among 27 types of gestures, we determined the seven suitable gestures for EarHover in terms of signal discrimination and user acceptability. We then evaluated the gesture detection and classification performance of two prototype devices (in-ear type/open-ear type) for real-world application scenarios.